Vibe Code đang nổi lên như một giải pháp tuyệt vời thay thế cho các công ty phần mềm hỗ trợ doanh nghiệp phát triển nhanh phần mềm cho riêng mình. Ý tưởng nghe thật hấp dẫn, nhưng CEO tự học AI và Vibe Code cho chính doanh nghiệp mình lại tiềm ẩn rất nhiều rủi ro đấy.

Vibe Code thần kỳ như nào?

Bạn có một ý tưởng ứng dụng tuyệt vời. Bạn mở Cursor, gõ vài dòng mô tả bằng tiếng Việt, và Claude hay GPT-5 lập tức “phun” ra hàng trăm dòng code hoàn chỉnh. Chưa đầy 30 phút, ứng dụng đã chạy ngon lành. Cảm giác thật sự “phê” – đó chính là lý do Andrej Karpathy, cựu giám đốc AI của Tesla, gọi nó là “Vibe Coding”: viết code theo cảm hứng, không cần hiểu code, chỉ cần mô tả bằng ngôn ngữ tự nhiên.

Xu hướng này đang bùng nổ chóng mặt. 75% lập trình viên đã sử dụng một hình thức vibe coding nào đó, và 90% thấy nó hữu ích. Các công cụ như Cursor, Claude Code, GitHub Copilot, Windsurf, Orchids và Lovable đã trở thành “trợ thủ đắc lực” cho hàng triệu người, từ developer chuyên nghiệp cho đến những người chưa từng viết một dòng code nào.

Thần kỳ và rủi ro

Nhưng có một sự thật đáng sợ mà ít ai nói với bạn: ứng dụng vibe-coded của bạn gần như chắc chắn chứa lỗ hổng bảo mật nghiêm trọng.

Hãy nhìn vào con số này: trong một nghiên cứu của Đại học Carnegie Mellon, 61% code do AI tạo ra vượt qua bài kiểm tra chức năng, nhưng chỉ 10,5% vượt qua bài kiểm tra bảo mật. Nói cách khác, cứ mỗi 10 tính năng AI giúp bạn ship thành công, thì có tới 9 tính năng chứa lỗ hổng có thể bị khai thác. Một nghiên cứu khác của Veracode cho thấy code do AI tạo ra chứa lỗ hổng bảo mật nhiều gấp 2,74 lần so với code do con người viết. Và trong quý 1/2026, đánh giá hơn 200 ứng dụng vibe-coded cho thấy 91,5% chứa ít nhất một lỗ hổng có nguồn gốc từ “ảo giác AI”.

Khoảng cách giữa “nó chạy được” và “nó an toàn” chưa bao giờ lớn đến thế. Và với tư cách là CEO – người chịu trách nhiệm cuối cùng về dữ liệu doanh nghiệp – bạn không thể phớt lờ khoảng cách đó.

Việc CEO doanh nghiệp tự vibe code là quá nguy hiểm

Vì sao AI không quan tâm đến bảo mật?

Nhiều người lầm tưởng rằng AI đang “review” code của họ một cách toàn diện như một senior engineer. Sự thật không phải vậy.

AI được tối ưu hóa cho mục tiêu bạn đặt ra. Và mục tiêu đó hầu như luôn là chức năng: “xây trang đăng nhập”, “thêm form thanh toán”, “tạo REST API”. Bảo mật là một “non-goal” – thứ AI không quan tâm trừ khi bạn yêu cầu cụ thể. Và để ra yêu cầu cụ thể về bảo mật, rất tiếc, chỉ có những kỹ sư CNTT được đào tạo bài bản mới có thể biết.

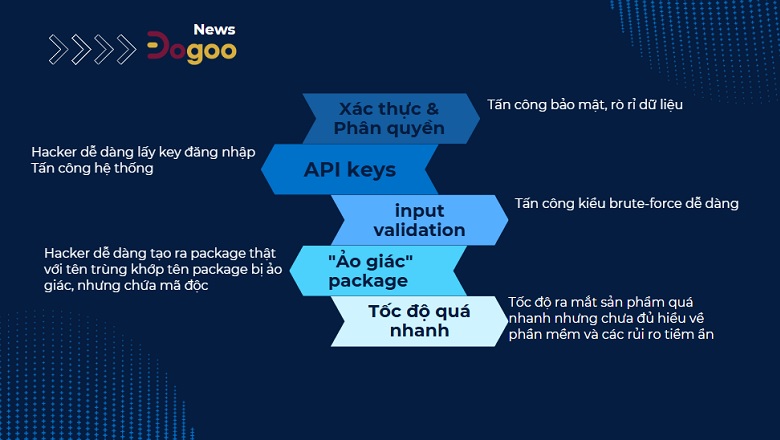

05 rủi ro bảo mật nghiêm trọng từ vibe coding mà CEO cần biết

Xác thực và phân quyền “ma” – cánh cửa mở toang cho hacker

Đây là lỗ hổng phổ biến và nguy hiểm nhất. Trong một đợt audit 21 ứng dụng vibe-coded công khai, 43% thiếu authentication hoặc có thể bypass authentication trên các serverless endpoints. Một nghiên cứu khác phát hiện 80% giải pháp “chạy đúng chức năng” từ AI chứa lỗ hổng bảo mật, phần lớn liên quan đến xác thực và phân quyền.

AI thường tạo ra những logic “ngược đời”: cho phép anonymous user truy cập toàn bộ dữ liệu nhưng lại chặn authenticated user. Nó cũng mặc định cấu hình Row Level Security (RLS) trên Supabase với logic sai cơ bản: kiểm tra “người dùng đã đăng nhập chưa” thay vì “người dùng có sở hữu dữ liệu này không” – khiến bất kỳ ai đăng nhập cũng có thể đọc toàn bộ dữ liệu của người khác.

API keys và secrets “phơi bày” trong code frontend

AI có thói quen nguy hiểm: hardcode thẳng API keys, database passwords, và JWT secrets vào code client-side. Nghiên cứu từ Invicti trên 20.000 ứng dụng AI-generated cho thấy mỗi model AI đều tái sử dụng cùng một giá trị secret mặc định – ví dụ, chuỗi supersecretkey xuất hiện trong 1.182 ứng dụng.

CodeRabbit phát hiện rằng AI-generated pull requests chứa hardcoded credentials với tỷ lệ gần gấp đôi so với code do con người viết. Điều này có nghĩa là chỉ cần một hacker mở Developer Tools trên trình duyệt, tìm kiếm chuỗi eyJ (prefix của JWT), họ có thể lấy được key xác thực và truy cập toàn bộ hệ thống của bạn.

“Ảo giác” package và rủi ro chuỗi cung ứng

LLM không “biết” package nào thực sự tồn tại – nó “đoán” dựa trên xác suất. Kết quả là AI thường xuyên “ảo giác” ra những tên package không có thật. Một nghiên cứu cho thấy gần 20% package AI đề xuất là bịa đặt, và 43% trong số đó xuất hiện nhất quán qua nhiều lần query.

Hacker có thể lợi dụng điều này thông qua kỹ thuật “slopsquatting”: tạo ra package thật với tên trùng khớp tên package bị ảo giác, nhưng chứa mã độc. Khi developer vô tư cài đặt, hậu quả là toàn bộ hệ thống bị tấn công. Đầu năm 2026, một cuộc tấn công chuỗi cung ứng nhắm vào LiteLLM đã khiến 47.000 lượt tải package nhiễm độc chỉ trong 46 phút.

Thiếu rate limiting và input validation – “miếng mồi ngon” cho brute-force

AI hầu như không bao giờ tự động thêm giới hạn đăng nhập trong Xác thực đăng nhập. Không giới hạn số lần thử login. Không áp dụng thời gian chờ yêu cầu để Reset mật khẩu. Không giới hạn số lượng API calls. Tất cả những gì hacker cần là một script đơn giản để brute-force hàng nghìn lần mà không bị phát hiện.

Tương tự, Xác thực dữ liệu đầu vào (input validation) lớp phòng thủ cơ bản nhất chống SQL injection và XSS – cũng thường xuyên bị AI bỏ qua. Form được tạo ra, dữ liệu được gửi thẳng vào database, không một bước kiểm tra nào ở giữa. Nghiên cứu cho thấy AI-generated code chứa lỗ hổng XSS trong 86% trường hợp và thiếu input validation trong API endpoints ở 88% trường hợp.

Tốc độ vượt xa tầm kiểm soát trong doanh nghiệp

AI-generated code được deploy nhanh hơn khả năng review có ý nghĩa của con người. Các bộ phận kinh doanh đang tự ý triển khai AI agents mà nhóm kỹ thuật/ phòng ban Công nghệ thông tin không hề hay biết.

Một khảo sát gần đây cho thấy: 86% tổ chức đã tích hợp AI-generated code vào workflow, 89% tin rằng họ có thể bảo mật code đó – nhưng chỉ 17% thực sự có cái nhìn đầy đủ vào code AI tạo ra. Khoảng cách giữa niềm tin và thực tế này đang tạo ra một làn sóng “shadow AI” – tương tự như shadow IT thời kỳ đầu của cloud, nhưng nguy hiểm hơn nhiều.

Trưởng bộ phận an ninh mạng quốc gia Anh (NCSC) gần đây đã gọi rủi ro bảo mật từ AI-generated code là “không thể chấp nhận được” và kêu gọi hợp tác quốc tế – không phải hướng dẫn, không phải best practices, mà là hợp tác quốc tế. Đó là ngôn ngữ mà chính phủ dùng khi họ tin rằng vấn đề vượt quá khả năng giải quyết của bất kỳ quốc gia đơn lẻ nào.

CEO tự vibe code: “Con dao hai lưỡi” với dữ liệu doanh nghiệp

Khi một CEO quyết định tự tay vibe code ứng dụng quản lý nhân sự, CRM nội bộ, hay dashboard kinh doanh, rủi ro không chỉ dừng lại ở lỗ hổng kỹ thuật. Dữ liệu nhạy cảm của doanh nghiệp đang bị đặt vào tình thế nguy hiểm.

Hãy tưởng tượng: ứng dụng quản lý nhân sự bạn tự vibe code vô tình expose API key Supabase trong bundle JavaScript. Một attacker với tài khoản miễn phí có thể:

– Đọc toàn bộ hồ sơ nhân viên, bao gồm lương, đánh giá hiệu suất, thông tin cá nhân

– Trích xuất danh sách khách hàng và hợp đồng từ CRM

– Truy cập dữ liệu tài chính nội bộ từ dashboard kinh doanh

Đây không phải là kịch bản giả tưởng. Lovable – nền tảng vibe coding trị giá 6,6 tỷ USD với 8 triệu người dùng – đã để lộ source code, database credentials và dữ liệu cá nhân của hàng nghìn người dùng trong 48 ngày trước khi lỗ hổng được phát hiện.

Vấn đề còn nằm ở chỗ: CEO không phải là người hiểu sâu về code và bảo mật. Việc tự vibe code tạo ra một ảo tưởng nguy hiểm – ứng dụng “chạy được” đồng nghĩa với “an toàn”. Nhưng như các chuyên gia bảo mật đã chỉ ra: “Mọi ứng dụng vibe-coded chưa trải qua một đợt security audit có chủ đích đều ở trạng thái: hoạt động hoàn hảo. Và rộng mở cho tấn công”.

Danh sách các rủi ro hàng đầu khi CEO tự vibe code cần chú ý

Giải pháp: Đừng tự mày mò – Hãy để chuyên gia lo

Vibe coding không xấu. Nó là công cụ mạnh mẽ để tạo prototype, thử nghiệm ý tưởng, và tăng tốc phát triển phần mềm. Nhưng khi nói đến phát triển ứng dụng – đặc biệt là những ứng dụng xử lý dữ liệu kinh doanh và nhân sự nhạy cảm – vibe coding cần được đặt trong một quy trình có kiểm soát chuyên nghiệp.

Vậy CEO nên làm gì?

- Không tự vibe code ứng dụng production: Đặc biệt là các ứng dụng liên quan đến dữ liệu nhạy cảm. Hãy coi ứng dụng bạn tự vibe code như một bản demo ý tưởng, không phải sản phẩm cuối cùng.

- Thiết lập quy trình security review bắt buộc: Mọi code do AI tạo ra trước khi lên production cần được audit bảo mật – kiểm tra authentication, authorization, secrets management, input validation, và rate limiting.

- Sử dụng công cụ scan bảo mật tự động: Các công cụ như SAST, SCA, và secrets scanning nên được tích hợp vào CI/CD pipeline. Những công cụ này có thể phát hiện hardcoded secrets, lỗ hổng bảo mật, và các lỗ hổng OWASP Top 10 trước khi code được deploy.

- Đào tạo nhân sự về secure AI coding: Nhân sự trong doanh nghiệp cũng cần được đào tạo về cách bảo mật dữ liệu trong quá trình sử dụng AI để code tính năng, phát triển thêm tính năng.

- Tìm một team chuyên nghiệp: Đây là giải pháp quan trọng nhất. Thay vì tự mày mò và đối mặt với rủi ro không lường trước, hãy hợp tác với một team có chuyên môn sâu về cả code và bảo mật. Họ sẽ giúp bạn:

- Audit và vá lỗ hổng trong ứng dụng hiện tại

- Thiết lập quy trình phát triển an toàn cho tương lai

- Đảm bảo dữ liệu doanh nghiệp được bảo vệ đúng mức

Dogoo Vibe – Đối tác tin cậy cho hành trình chuyển đổi số an toàn

Trong bối cảnh vibe coding đang tạo ra những rủi ro bảo mật chưa từng có, Dogoo Vibe nổi lên như một giải pháp toàn diện dành cho các CEO và doanh nghiệp Việt Nam.

Dogoo Vibe không chỉ là một team phát triển phần mềm thông thường. Nhân sự Dogoo Vibe là các chuyên gia có chuyên môn sâu về cả lập trình và bảo mật, với kinh nghiệm thực chiến trong việc phát hiện và xử lý các lỗ hổng bảo mật trong ứng dụng. Đội ngũ của Dogoo Vibe hiểu rõ những cạm bẫy mà AI-generated code mang lại, và quan trọng hơn – họ biết cách phòng tránh và khắc phục chúng.

Các chuyên gia từ Dogoo Vibe sẽ đồng hành cùng bạn

Lộ trình Dogoo Vibe rõ ràng

Thay vì để CEO tự mày mò vibe code, đối mặt với nguy cơ lộ lọt dữ liệu kinh doanh, nhân sự và tài chính, Dogoo Vibe cung cấp một lộ trình chuyên nghiệp:

- Audit bảo mật toàn diện cho ứng dụng hiện có, phát hiện và vá mọi lỗ hổng tiềm ẩn

- Tư vấn và triển khai quy trình phát triển an toàn, kết hợp sức mạnh của AI với kiểm soát chặt chẽ của con người

- Quản trị rủi ro dữ liệu nhạy cảm, đảm bảo thông tin kinh doanh và nhân sự luôn được bảo vệ

Trong thời đại mà AI có thể tạo ra hàng nghìn dòng code trong vài phút, sự khác biệt không nằm ở tốc độ – mà nằm ở sự an toàn và bền vững. Đừng để ứng dụng của bạn trở thành “miếng mồi ngon” cho hacker chỉ vì một lỗ hổng mà AI đã vô tình tạo ra.

Hãy để Dogoo Vibe đồng hành cùng bạn trên hành trình chuyển đổi số – nơi tốc độ và bảo mật luôn song hành.

>> Xem thêm:

- Hướng Dẫn Doanh Nghiệp Việt Nam Sử Dụng Vibe Coding Hiệu Quả

- 10 Case Study Ứng dụng AI tạo sinh thực tế mà các CEO nên biết

Dogoo.vn